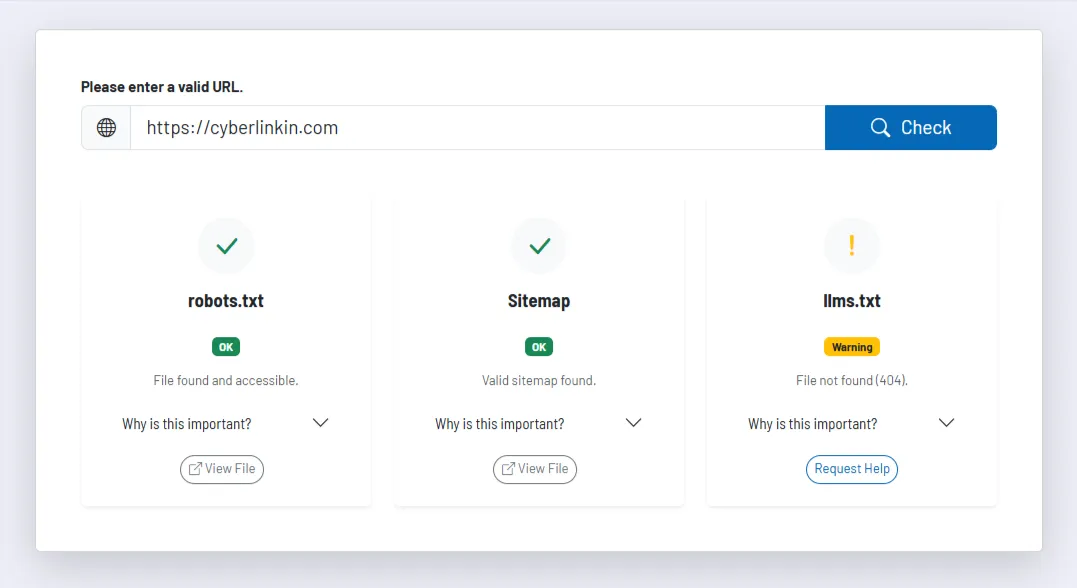

Der System File Check prüft zentrale technische Steuerdateien Ihrer Website in einem kompakten Arbeitsgang. Im Fokus stehen dabei insbesondere robots.txt, Sitemap-Dateien und llms.txt, also genau die Dateien, die für Suchmaschinen, Crawler und zunehmend auch für KI-Systeme wichtige Signale über Struktur, Freigaben und Auffindbarkeit liefern.

In diesem Artikel

Das Tool eignet sich besonders gut für technische Audits, Relaunches, SEO-Freigaben und Qualitätskontrollen nach Deployment oder Hosting-Wechsel. Statt jede Datei einzeln manuell aufzurufen und deren Zustand selbst zu interpretieren, erhalten Sie pro Datei einen verständlichen Status, eine kurze fachliche Einordnung und bei Bedarf einen direkten Link zur geprüften Ressource.

So funktioniert das Tool in der Praxis

Sie geben die URL Ihrer Website ein und starten die Analyse. Das Tool normalisiert die Adresse, leitet daraus die Basis der Domain ab und prüft anschließend die typischen Zielpfade für robots.txt, verschiedene Sitemap-Varianten und llms.txt. Falls die Sitemap nicht an einem Standardpfad liegt, wird zusätzlich geprüft, ob die robots.txt auf eine konkrete Sitemap verweist.

Für jede Datei erhalten Sie einen eigenen Status. Das Tool erkennt nicht nur, ob eine Ressource existiert, sondern auch, ob sie inhaltlich plausibel wirkt oder lediglich eine HTML-Seite statt der erwarteten Datei zurückliefert. Gerade solche Soft-404-Situationen sind in der Praxis häufig und bleiben bei einer oberflächlichen Sichtprüfung leicht unbemerkt.

Zusätzlich erklärt das Tool für jede Datei kurz, warum sie relevant ist und welche Auswirkung ein fehlender oder fehlerhafter Zustand haben kann. Damit ist die Ausgabe nicht nur technisch korrekt, sondern auch im Alltag besser kommunizierbar, etwa gegenüber Marketing, Redaktion oder Projektleitung.

Kernfunktionen und wichtige Ansichten

robots.txtwird darauf geprüft, ob die Datei erreichbar ist, ob sie wie eine echte Steuerdatei wirkt und ob darin ein Sitemap-Hinweis gefunden werden kann.- Die Sitemap-Prüfung berücksichtigt mehrere typische Standardpfade und kann zusätzlich einen in

robots.txtgenannten Sitemap-Pfad übernehmen. Dadurch steigt die Wahrscheinlichkeit, auch abweichend konfigurierte Setups korrekt zu erfassen. llms.txtwird als eigenständiger Prüfpunkt behandelt. Das ist besonders interessant für Teams, die ihre Inhalte auch im Kontext von KI-Sichtbarkeit und strukturierter Signalgabe sauber aufstellen möchten.- Jede Karte enthält Status, erläuternden Kontext, Relevanzhinweise und bei erfolgreicher Prüfung einen direkten Link zur Datei. Dadurch lässt sich aus der Diagnose sofort in die manuelle Sichtprüfung oder Korrektur übergehen.

Empfohlene Arbeitsweise

Nutzen Sie das Tool idealerweise nach technischen Änderungen, Relaunches oder CMS-Updates als festen Prüfpunkt. Besonders wichtig ist die Kontrolle, wenn Weiterleitungen, Caching, Sicherheitsregeln oder Hosting-Komponenten verändert wurden, weil gerade dann oft statt der erwarteten Systemdatei nur noch generische HTML-Antworten ausgeliefert werden.

Wenn Warnungen auftreten, sollten Sie nicht nur die Datei selbst betrachten, sondern auch deren Einbindung in Ihre Gesamtstruktur. Eine formal vorhandene Sitemap nützt wenig, wenn sie nicht aktuell ist, und eine erreichbare robots.txt kann trotzdem unerwünschte Sperren enthalten. Das Tool liefert die erste technische Einordnung, die in den nächsten Schritt Ihrer Detailprüfung überführt werden sollte.